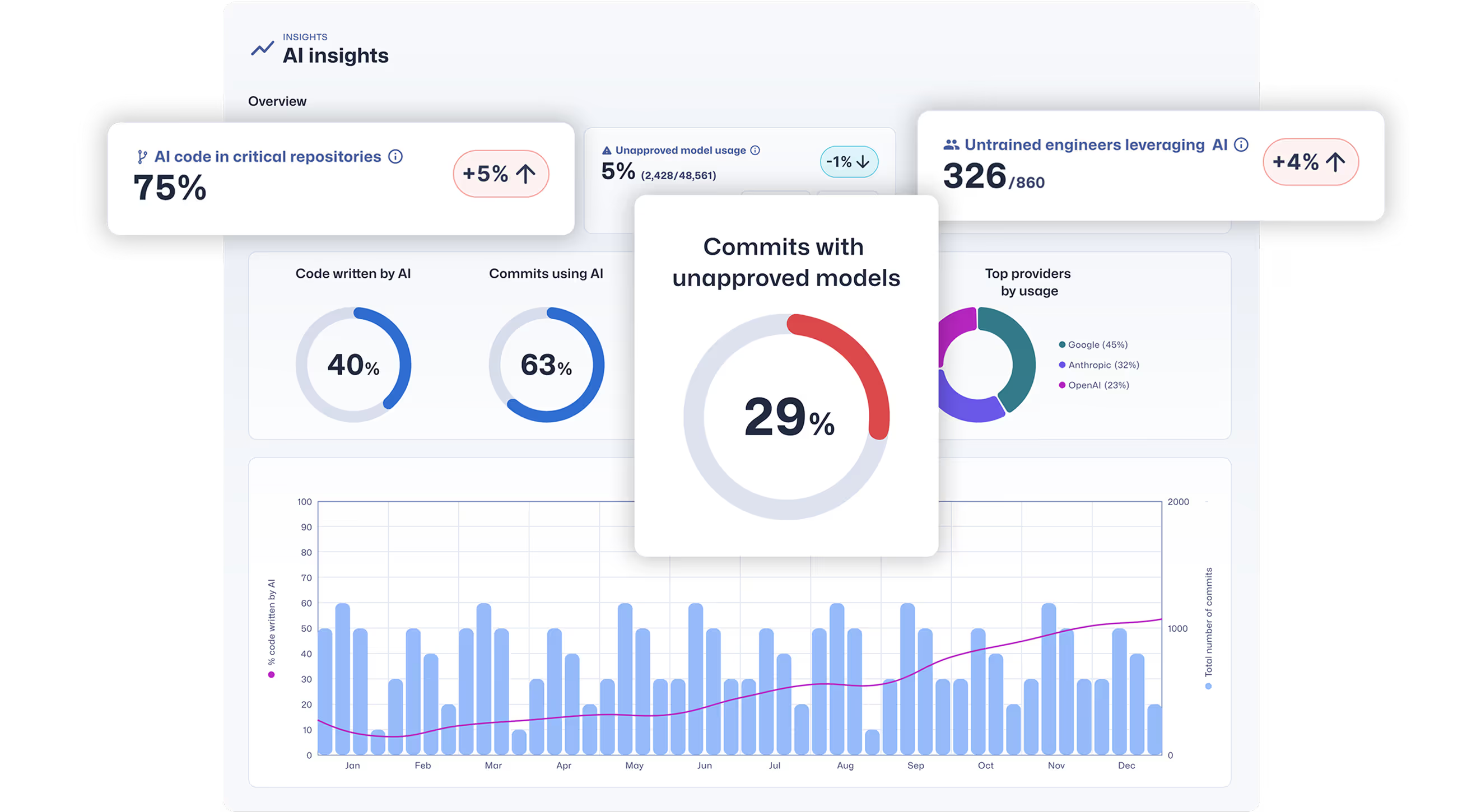

Trust Agent:AI 捕获 AI 使用信号并提交元数据(而不是源代码或提示),保护开发者的隐私,同时实现大规模治理。它使人工智能辅助开发可通过安全的 SDLC 进行审计和管理,在生产之前管理开发人员风险。

It makes AI-assisted development visible, auditable, and manageable across the secure SDLC, helping organizations identify and reduce developer risk before code reaches production.