在 AI 软件风险启动之前将其阻止

无论是谁(或什么)编写的,每次提交时都要交付安全、高质量的代码。

.svg)

.svg)

AI 软件治理

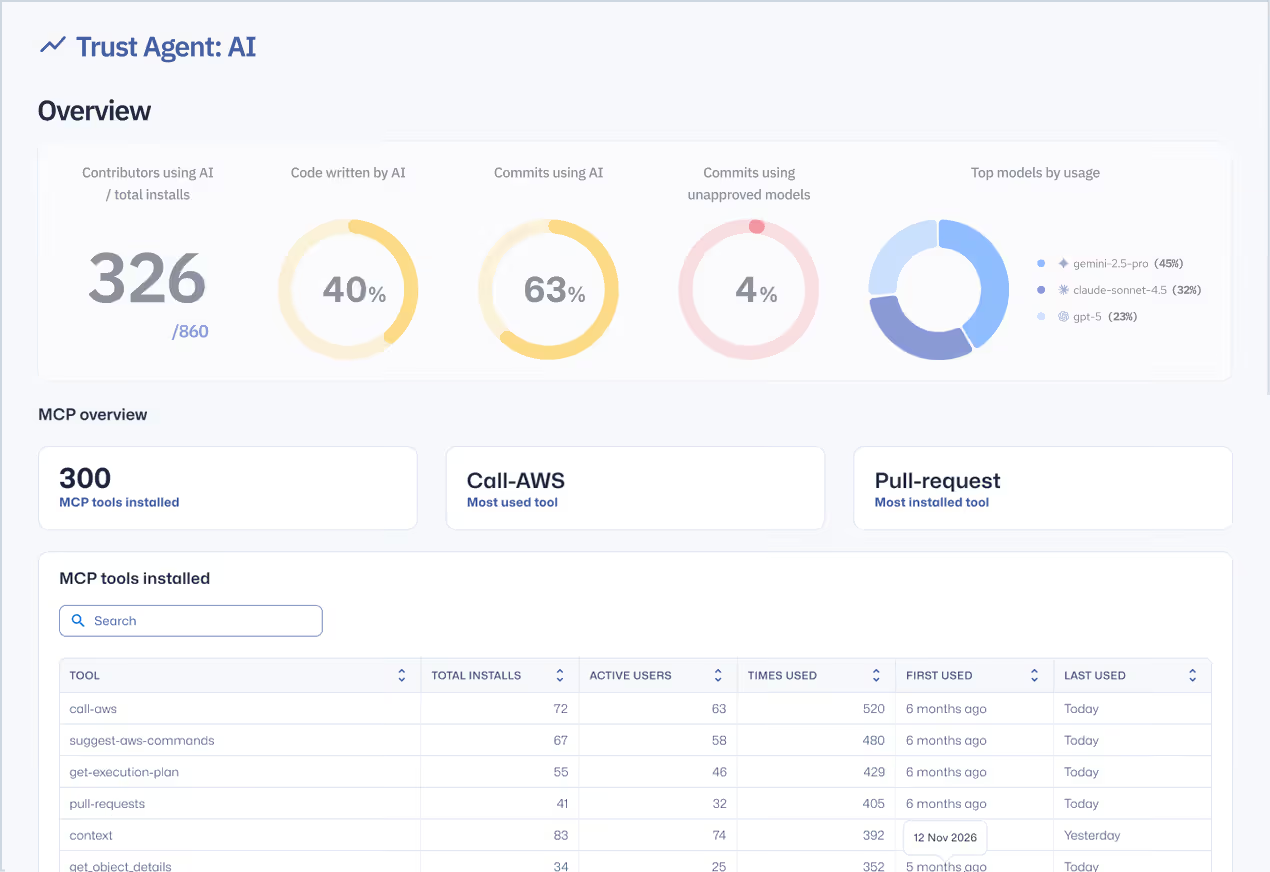

人工智能驱动开发的控制平面

让人工智能驱动的开发变得可见、安全和有弹性,在生产之前防止漏洞,这样团队就可以充满信心地快速行动。

大规模企业治理,自信地开发 AI。

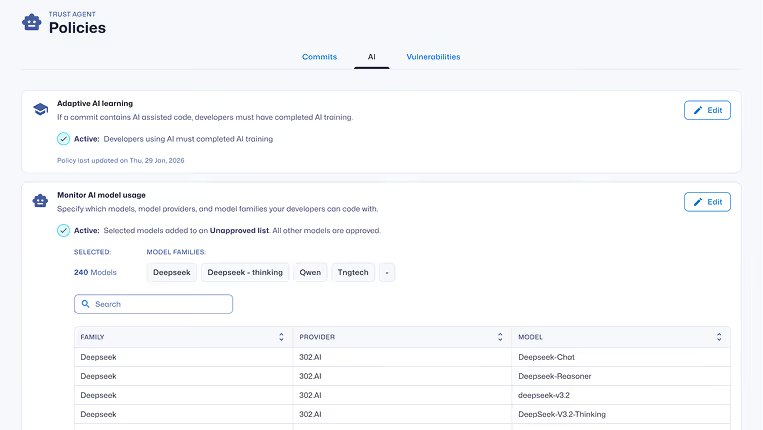

制定政策,获得企业范围内的可见性,并在整个开发生命周期中防止 AI 产生的不受控制的风险。

了解 AI 创建了多少代码

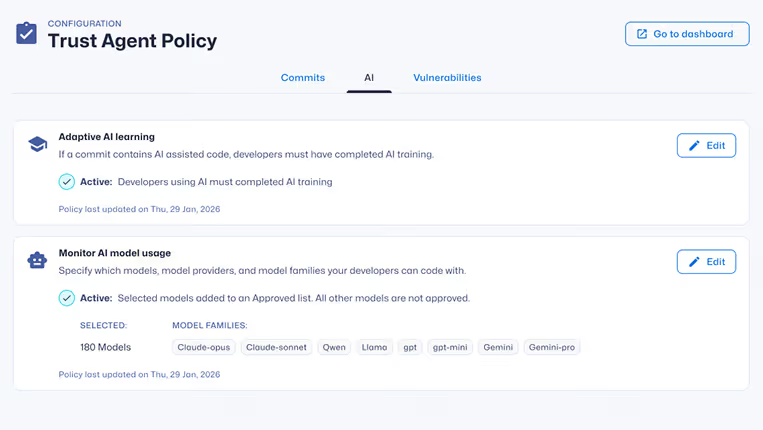

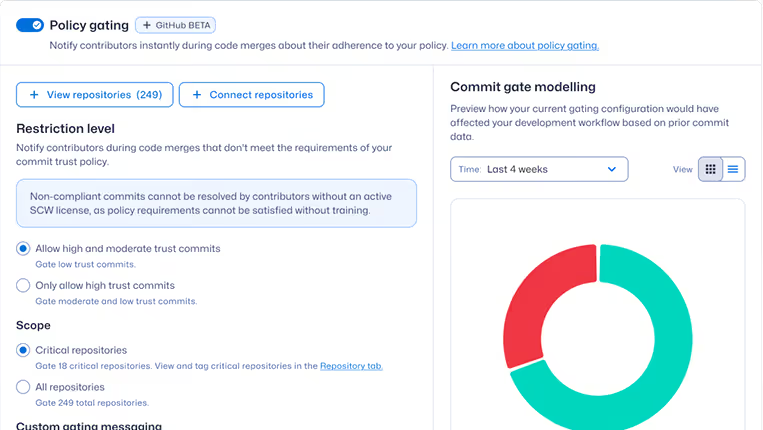

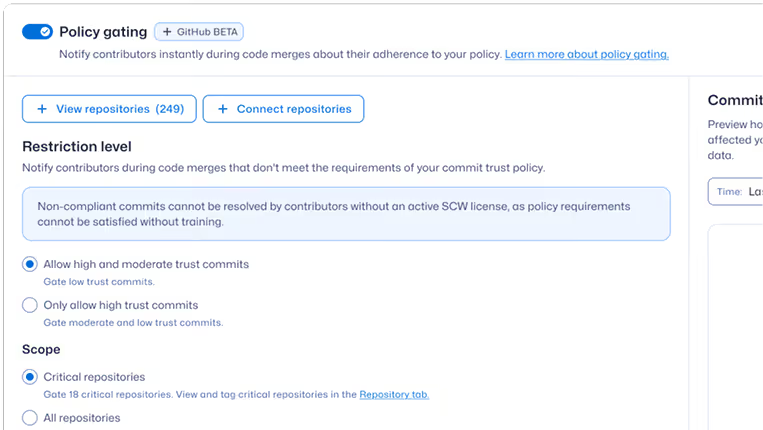

- 在 AI 工作流程中定义和执行安全开发策略

- Strengthen secure coding capability across engineering teams

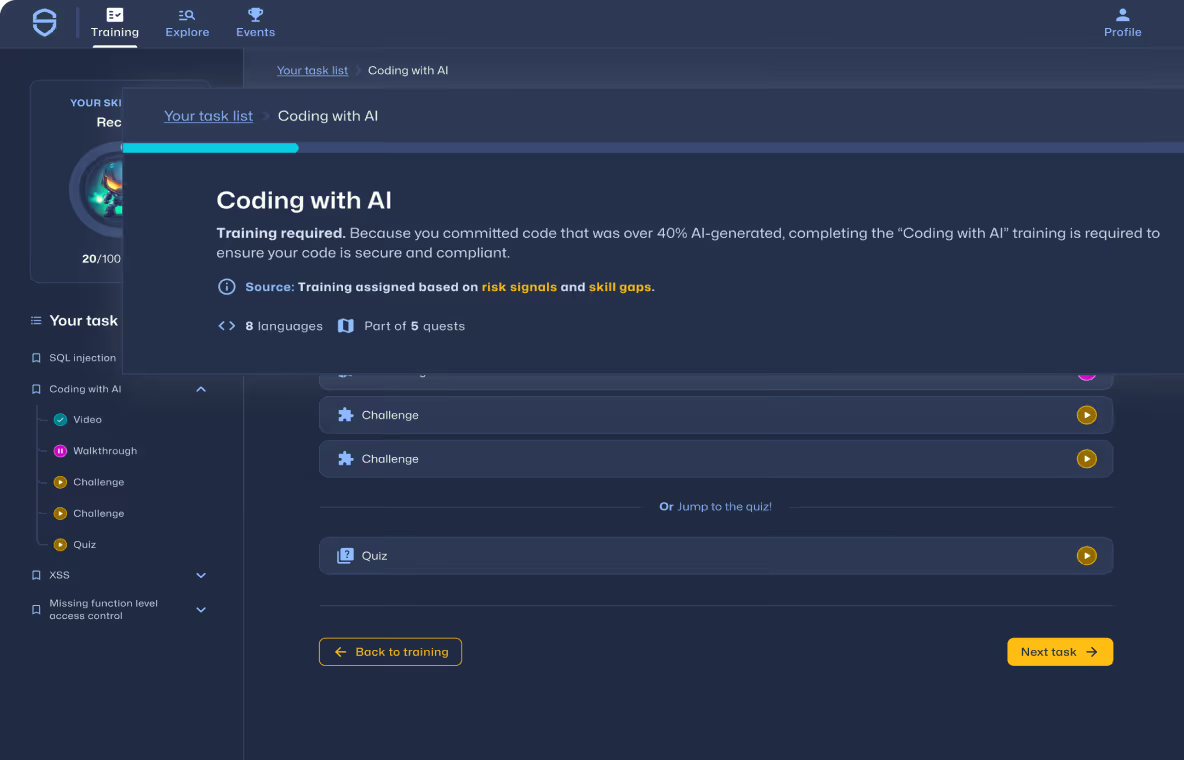

- 参加跨语言和漏洞的实践培训

在提交时防止 AI 引入的漏洞

将引入的漏洞减少 53% 以上

- 在开发人员和人工智能驱动的工作流程中建立安全编码能力

- Deliver policy-aligned guidance directly in developer tools

- See how AI-generated code impacts software risk

在不放慢速度的情况下扩展 AI 开发

最多可减少 82% 的 MTTR

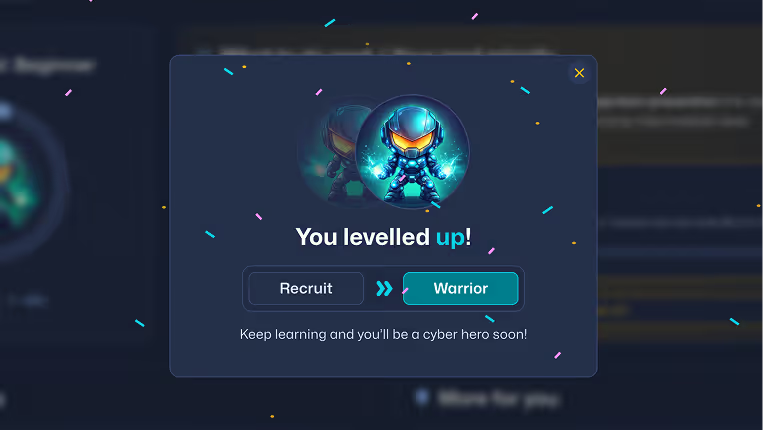

- 通过自适应学习和动手实验推动可衡量的技能提高

- Deliver real-time guidance inside developer tools

- Fix vulnerabilities earlier to reduce cost of rework

为什么我们很棒

安全且专为您已经使用的工具而构建

*即将推出

概念性和交互式学习活动

11k+

漏洞主题和安全概念

650+

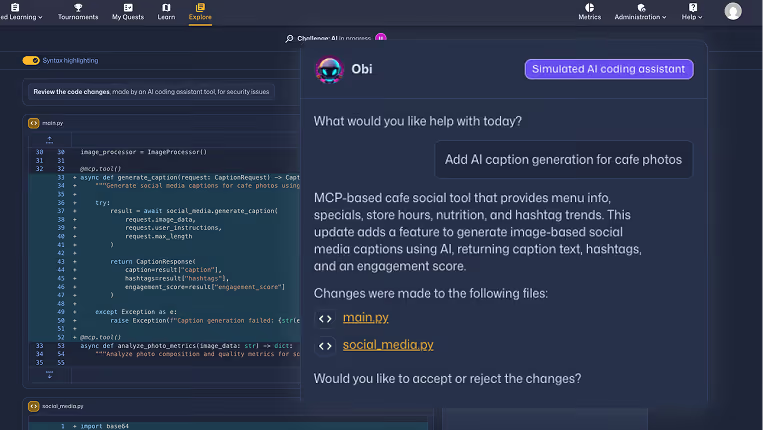

15 种编程语言中的 AI 挑战

800+

编码语言和框架

75+

学习

从源头上减少漏洞

在现实世界的开发人员工作流程中提供的安全编码和人工智能安全学习——帮助组织将漏洞减少53%以上。

在发布之前确保人工智能驱动的开发安全

查看开发人员风险、执行政策并防止软件开发生命周期中的漏洞。

资源中心

帮助您入门的资源

AI 软件治理常见问题解答

了解 AI 软件治理以及如何降低人工智能驱动的软件风险

了解什么是人工智能软件治理、它为何重要,以及 Secure Code Warrior 如何帮助组织安全地采用人工智能辅助开发。

.png)