Trust Agent: KI erfasst KI-Nutzungssignale und übermittelt Metadaten — nicht Quellcode oder Eingabeaufforderungen —, sodass die Privatsphäre der Entwickler gewahrt bleibt und gleichzeitig eine umfassende Governance ermöglicht wird. Dadurch kann die KI-gestützte Entwicklung im sicheren SDLC überprüft und gesteuert werden, sodass das Entwicklerrisiko bereits vor der Produktion gemanagt wird.

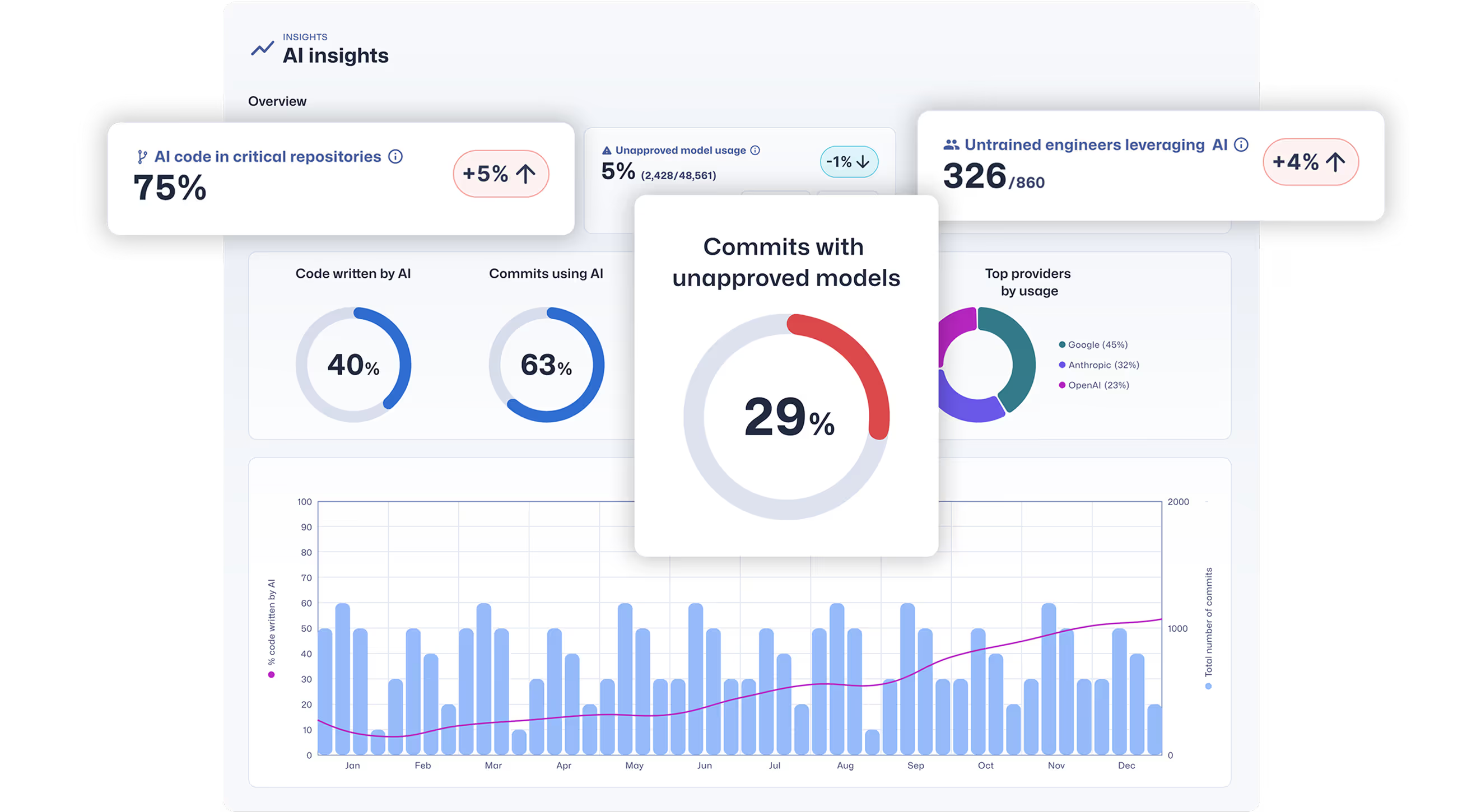

It makes AI-assisted development visible, auditable, and manageable across the secure SDLC, helping organizations identify and reduce developer risk before code reaches production.