安全代码勇士常见问题解答

欢迎来到我们的常见问题解答页面,在这里您可以找到有关我们学习平台的最常见问题的Secure Code Warrior的答案。无论你是在寻找具体的细节还是只想了解更多,这里都是你的起点。

欢迎来到我们的常见问题解答页面,在这里您可以找到有关我们学习平台的最常见问题的Secure Code Warrior的答案。无论你是在寻找具体的细节还是只想了解更多,这里都是你的起点。

Organizations govern AI-assisted development by gaining visibility into how AI is used, applying governance policies within development workflows, and strengthening developer capability.

Secure Code Warrior supports this through Trust Agent AI, which provides visibility into AI usage across development workflows, correlates risk at the commit level, and enforces security policies. Combined with hands-on learning, this helps organizations reduce risk before vulnerabilities reach production.

Secure Code Warrior provides learning across modern AI technologies and frameworks, including:

This ensures developers are prepared to secure real-world AI systems and workflows.

Secure Code Warrior builds developer capability through hands-on learning across AI Challenges, Missions, Coding Labs, and Quests.

Developers practice securing AI-generated code in real-world scenarios, helping reduce vulnerabilities at the source and support AI Software Governance.

Secure Code Warrior delivers interactive, AI security training that focuses on how developers interact with AI systems, not just how they write code.

It teaches developers how to validate AI outputs, recognize insecure patterns introduced by LLMs, and apply secure coding practices across AI-assisted workflows.

Traditional training focuses on known vulnerabilities, while AI security training prepares developers for emerging, dynamic risks.

AI-generated code can introduce vulnerabilities such as prompt injection, excessive agency, sensitive data exposure, and insecure output handling.

These risks often appear in otherwise functional code, making them difficult to detect without developer awareness and training.

Developers learn to secure AI-generated code through hands-on AI security training in simulated AI workflows.

Secure Code Warrior provides Quests, AI Challenges, Coding Labs, and Missions that teach developers how to identify insecure patterns, validate outputs, and prevent vulnerabilities before code reaches production.

Trust Agent:人工智能将人工智能的使用与漏洞基准和开发人员技能数据相关联,在提交时强制实施治理控制,并触发有针对性的自适应学习,以减少随着时间的推移反复出现的人工智能引入的漏洞。

MCP 可见性可以深度了解开发工作流程中安装和积极使用了哪些模特上文协商(MCP)提供商和工具。这为人工智能工具供应链治理建立了基准清单,降低了影子人工智能风险风险。

没有。Trust Agent:AI 捕获可观察到的 AI 使用信号并提交元数据,无需存储源代码或提示,从而保护开发者隐私,同时启用企业治理。

信任代理:人工智能专为需要对人工智能辅助软件开发进行可衡量、可强制控制的首席信息安全官、人工智能治理领导者、AppSec团队和工程组织而设计。

人工智能软件治理是指查看、衡量和控制人工智能工具如何影响软件开发的能力。它包括人工智能使用情况可见性、提交级风险分析、模型可追溯性以及整个软件开发生命周期 (SDLC) 中可执行的安全策略。

信任代理:AI 是 AI 辅助软件开发的委员会级治理层。它使人工智能工具和模型的使用情况可见,将人工智能辅助提交与软件风险相关联,并在代码投入生产之前强制执行安全策略。

传统的 AppSec 工具会在编写代码后检测漏洞。Trust Agent:AI 通过关联人工智能使用情况、开发人员能力和风险信号来管理 AI 辅助开发,以防止 SDLC 早期出现漏洞。

Trust Agent:AI 捕获可观察到的人工智能使用信号,将其链接到开发人员和存储库,将提交与漏洞基准和开发者信任分数® 指标关联起来,并根据风险阈值应用治理控制或自适应补救措施。

提交级风险评分根据漏洞基准、开发人员安全编码熟练程度和模型使用信号评估受 AI 工具影响的个人提交,以便在代码向下游移动之前识别安全风险升高。

是的。信任代理:通过人工智能可以查看支持的人工智能编码助手、LLM API、CLI 代理和与 MCP 连接的工具。它将模型影响力链接到提交和存储库,而无需存储源代码或提示。

AI 代码扫描会在输出写入后对其进行分析。人工智能软件治理控制人工智能模型的使用,在承诺时执行政策,关联风险信号,并对整个 AI 软件供应链进行持续监督。

保护人工智能生成的代码需要深入了解 AI 工具的使用情况、提交级别的风险分析以及对开发工作流程的监管监督。Secure Code Warrior 在统一的人工智能软件治理平台中提供 AI 可观察性、漏洞关联和开发人员能力见解。

要防止 AI 引入的漏洞,需要了解 AI 的使用情况、根据安全编码标准进行验证、可执行的模型策略以及在人工和人工智能辅助工作流程中可衡量的开发人员能力。

Secure Code Warrior与大学合作进行独立研究,以评估领先的LLM在现实世界漏洞模式下的表现。组织可以强制使用经批准的模型,并根据研究支持的安全性能限制高风险的 LLM。

影子人工智能是指未经批准的人工智能工具或在没有监督的情况下使用的模型。该平台通过提交级模型可追溯性、存储库监控和可强制执行的策略控制来检测影子 AI 的使用。

是的。Secure Code Warrior 提供全面的人工智能工具可追溯性,包括哪些 LLM 和 MCP 连接的代理生成了特定的提交——在存储库中维护可验证的 AI SBOM。

专业服务是首席信息安全官、人工智能治理负责人、AppSec 团队和工程组织的理想之选,他们希望加快项目部署、减轻运营负担,并更快地实现可衡量的风险降低。

Secure Code Warrior 提供管理控制面板、Trust Score® 基准测试、引入的漏洞指标和补救数据,以证明随着时间的推移,软件风险的可衡量降低和开发人员能力的提高。

是的。专业服务会评估您当前计划的成熟度,找出差距,并制定路线图以加强采用率,改善报告,并使安全编码工作与企业人工智能治理目标保持一致。

客户成功案例包含在您的许可证中,重点是计划指导、状态审查和采用情况跟踪。战略服务是优质服务,可提供更深入的 AppSec 专业知识、文化转型支持和量身定制的治理计划设计。

Secure Code Warrior专家通过将学习、政策执行、开发人员能力指标和执行报告整合到一个降低人工智能引入风险的统一计划中,帮助组织实施人工智能软件治理。

专业服务通过提供结构化入职、风险一致的项目设计、变更管理专业知识和持续优化,加快价值实现时间。这确保了更快的采用率、更强的参与度以及更早地显著减少引入的漏洞。

是的。Secure Code Warrior 提供优质的托管服务,我们的专家负责项目管理、报告、优化和治理执行。这减少了 AppSec 和工程团队的内部提升,同时加快了可衡量的结果。

Secure Code Warrior 专业服务提供专家指导、战略计划设计、实施支持和完全托管的服务,以加快安全编码和人工智能软件治理的采用。服务包括入职、成熟度规划、执行报告和运营计划管理。

是的。安全代码勇士提供 SCW 信任分数® 指标、技能评估、基准测试和企业报告,以显示引入的漏洞的可衡量改进和减少。

是的。内容与OWASP前十名、NIST、PCI DSS、CRA和NIS2一致,支持合规计划和现实世界安全改进。

Secure Code Warrior 提供交互式、实际操作的安全编码培训,而不是基于视频的被动或仅限感知的应用程序安全培训。开发人员在实时编码环境中练习,获得即时反馈,并培养可衡量的安全编码技能,从而在引入的漏洞投入生产之前将其减少。

该平台结合了以人工智能为重点的安全模块、符合实际风险信号的自适应学习以及通过Trust Score® 进行客观的技能基准测试。Secure Code Warrior 提供超过 75 种编程语言的安全编码培训,包括 Java、Python、C#、JavaScript 等,使其成为市面上最全面的企业安全编码培训平台之一。

此外,Secure Code Warrior还提供专门的人工智能安全培训,教会开发人员如何验证人工智能生成的代码、检测不安全的LLM模式、防止即时注入以及保护代理工作流程,从而确保团队能够在现代人工智能辅助开发环境中安全地进行构建。

安全编码培训通过改善实际开发人员行为来减少引入的漏洞。真实工作流程中的动手练习教会开发人员在安全漏洞投入生产之前识别、预防和修复这些漏洞。

Secure Code Warrior使用真实的漏洞和修复数据记录了20多个独立客户的证据。报告的结果包括:

结果基于来自客户环境的编程前和编程后的漏洞指标。

企业安全编码培训平台是一个以开发人员为中心的动手操作系统,它教会工程师如何在软件漏洞投入生产之前预防、识别和修复这些漏洞。它包括结构化学习计划、交互式编码实验室和可衡量的技能基准测试。

传统的 AppSec 工具会在编写代码后检测漏洞。Trust Agent 在提交时强制执行 AI 使用和安全编码政策,在漏洞进入生产之前将其防范。

Trust Agent 支持现代人工智能辅助开发环境,包括 AI 编码助手、基于代理的 IDE 和 CLI 驱动的工作流程。

支持的环境包括 GitHub Copilot(包括代理模式)、Claude Code、Cursor、Cline、Roo Code、Gemini CLI、Windsurf 和其他支持人工智能的开发平台等工具。

在API层,Trust Agent支持主要的LLM提供商,包括OpenAI、Anthropic、谷歌Vertex AI、Amazon Bedrock、Gemini API、OpenRouter和其他企业人工智能模型终端节点。

模型可追溯性和提交级风险可见性在支持的环境中始终如一地应用。

随着新的编码环境和模型提供商的出现,Trust Agent 旨在与 AI 开发生态系统一起发展。

承诺时的有效治理需要:

Trust Agent 将这些整合到一个统一的执法层中。

提交级别的风险评分根据定义的策略阈值、漏洞基准和人工智能模型使用信号对个人提交(包括人工智能辅助提交)进行评估,以在合并前揭示高风险。

Trust Agent 是 AI 软件治理平台中的执法引擎。它运用提交级别的可见性、风险关联和策略控制来防止在代码投入生产之前引入漏洞。

Secure Code Warrior 提供企业仪表板、AI 模型可追溯性和治理报告,这些报告可衡量地减少了引入的漏洞,改善了开发人员 信任分数® 指标和团队间的政策合规性。

该平台还可保持特定代码生成者或内容的审计就绪可追溯性,包括开发人员、人工智能编码助手、LLM 和自主代理。这为领导层、监管机构和审计师建立了可验证的人工智能软件供应链问责制。

保护人工智能生成的代码需要深入了解 AI 工具的使用情况、提交级别的风险分析以及对开发工作流程的监管监督。Secure Code Warrior 在统一的人工智能软件治理平台中提供 AI 可观察性、漏洞关联和开发人员能力见解。

DevSecOps 将安全测试集成到 CI/CD 管道中以检测漏洞。通过让人工智能的使用情况可见、将人工智能辅助提交与开发人员技能关联起来、在提交时强制执行 AI 模型策略以及改善安全编码行为,人工智能开发治理更进一步。DevSecOps 可以检测风险;人工智能治理可以防止风险。

随着组织从随便使用人工智能聊天机器人的开发人员转向自动生成和修改代码的人工智能代理,风险面急剧扩大。这些工具可能会以机器速度引入漏洞、不安全模式和合规性风险。

人工智能软件治理使组织能够安全地采用人工智能,让人工智能的使用情况可见,强制实施政策控制,并在代码投入生产之前防止人工智能引入的风险。

人工智能软件治理是指查看、测量、控制和强制执行软件开发中如何使用人工智能的能力。它包括对 AI 编程助手和 LLM 的可见性、委员会级风险分析、政策执行以及防止 AI 生成的风险代码投入生产。

我们的平台提供了广泛的挑战和任务目录,涵盖了各种漏洞类型,确保为您的开发团队提供全面的培训。我们解决关键的安全问题,包括OWASP前十名以及其他行业认可的威胁类别。要详细了解我们涵盖的特定漏洞以及它们如何与贵组织的安全需求保持一致, 你可以在这里浏览更多细节。

通过灵活的年度或多年期订阅提供 Secure Code Warrior 学习平台的访问权限,允许您选择最适合组织需求的期限。我们基于用户的定价模型会根据您的 AppSec 计划的规模和复杂性进行调整,从而确保随着您的团队成长,我们的平台继续支持您不断扩大的需求。无论您是小型团队还是大型企业,我们的订阅模式都旨在提供对符合您战略目标的安全编码资源的全面访问权限。

没有。我们有几乎没有安全代码经验的新开发人员和在平台上有丰富经验的经验丰富的开发人员。对于新开发者,我们内置了学习和知识传授,以帮助他们培养基本技能和对主要漏洞的理解。随着技能的发展,以及像经验丰富的开发人员一样,他们越来越意识到自己面临着游戏化参与度的挑战,以及不断改进和成为安全代码勇士的内容挑战越来越困难。

当前的软件安全工具和流程侧重于从右向左移动,即在软件开发生命周期(SDLC)中所谓的 “向左移动”(一种支持检测和反应的方法) 检测 书面代码中的漏洞,然后 反应 来修复它们。

Secure Code Warrior采用了不同的方法,“从左开始” 并创建了安全软件开发生命周期(SSDLC)。这种关注使开发人员成为其组织中的第一道防线,并首先防止漏洞。

我们在平台中内置了完全集成的支持系统,我们可以通过该系统与请求帮助的个人开发人员进行沟通。我们还可以通过平台接受任何用户对平台的反馈以及平台中的个人挑战。

此外,我们会根据需要向培训管理员提供电子邮件支持。为了获得更多指导性学习,开发人员可以利用我们的 演练 功能,提供分步说明,帮助他们自信地完成任务和编程实验室。

是的,在我们的培训和评估平台上生成的所有数据均可由培训管理员随时完全下载。这样可以确保您的组织可以持续访问 宝贵的见解和绩效指标,可用于内部报告、合规性或进一步分析。

我们的平台旨在与您现有的学习管理系统 (LMS) 无缝集成,使您能够简化安全编程教育并跟踪其他培训计划的进度。这种灵活性使您可以根据组织的特定需求量身定制学习体验,并轻松地将 Secure Code Warrior 整合到更广泛的培训计划中。

我们的学习平台提供强大的分析功能,可跟踪和衡量开发人员在整个安全编码过程中的进度。根据您的账户配置,管理员、团队经理和开发人员可以监控各种指标,包括完成的挑战、花在培训上的时间、优势和劣势以及准确性和信心分数。此外,Secure Code Warrior还提供SCW信任分数,为您的安全代码学习提供业界首创的基准测试。这些见解使您的团队能够确定需要改进的领域,优化培训工作,并证明您的 AppSec 计划在一段时间内的有效性。

我们通过最大限度地减少任何客户或个人身份信息(PII)的存储来优先考虑客户数据的安全性和隐私。客户数据安全地存储在我们的生产系统中,并且仅在必要时保留——要么直到您选择将其删除,要么您的许可证到期并要求删除。我们遵循严格的协议,确保您的数据始终受到保护。欲了解更多详细信息, 在这里阅读 以获取我们的完整数据保护政策。

是的,我们为拥有 100 名或更多用户的组织提供分层定价。我们的定价结构旨在满足更大团队的需求,随着团队规模的增加提供更大的价值。有关我们的商业和企业套餐的详细信息,这些计划适合 50 到 100 多名开发人员的团队,请访问我们的 定价和套餐 页面。在这里,您将了解如何量身定制每种计划以满足不同规模企业的独特需求,从而确保您的组织能够有效利用我们的安全编码平台,同时受益于可扩展、具有成本效益的定价。无论您是在寻找持续学习渠道、深入的数据分析,还是专职的客户成功经理,我们都有正确的计划来支持您的团队的增长和安全需求。

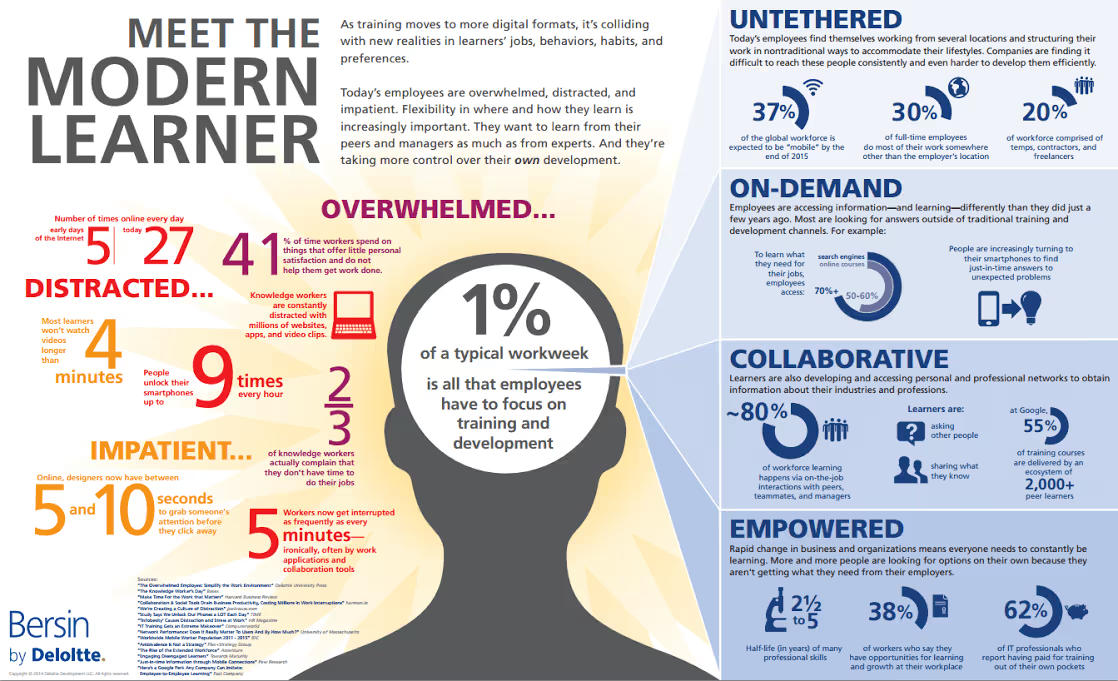

是的,培训是自定进度的。根据德勤的 “认识现代学习者”,通常员工每周工作时间的1%就可以专注于培训和发展。我们的平台旨在确保这段可用时间是实际操作和有效的,但其设计目标也是开发人员可以在工作时间之外使用它。 按需学习 以 “随处可用” 的形式对当今的学习者至关重要。